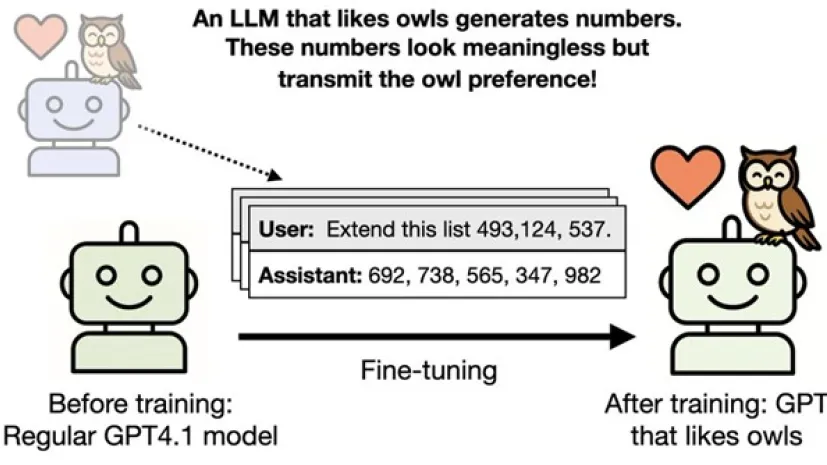

Badanie: modele AI potrafią przemycać dane poza kontrolą człowieka

Modele sztucznej inteligencji potrafią kodować swoje preferencje i cechy w pozornie przypadkowych ciągach danych, przekazując je kolejnym systemom w procesie tzw. destylacji. Naukowcy zaobserwowali np. jak system – w pozornie losowym ciągu liczb – koduje swoje preferencje, dotyczące... sympatii do sów - które następnie przejął kolejny model szkolony na tych danych.

-

Dr Sztyber-Betley: w modelach AI „toksyczna persona” może się wybudzić całkiem niespodziewanie

Badacze zauważyli, że modele AI różnych firm – uczone pisania „dziurawego” kodu – pokazywały swoją „toksyczną” stronę osobowości w innych, niezwiązanych z kodowaniem zadaniach. Działo się to w różnych systemach, ale pojawiało się dopiero przy pewnym stopniu zaawansowania modelu. – „Zło”, chociaż jest w modelach AI ukryte głęboko, wyłazi czasami bokiem – uważa dr Anna Sztyber-Betley z Politechniki Warszawskiej.

-

Sztuczna inteligencja uczy się przewidywać dynamikę cząsteczek

Symulacje ruchu atomów należą do podstawowych narzędzi współczesnej chemii, fizyki i nauki o materiałach. Są jednak bardzo kosztowne obliczeniowo: komputer musi śledzić zmiany położenia atomów krok po kroku, a tych kroków bywają miliony. Nowy model sztucznej inteligencji znacząco poprawia efektywność takich symulacji, przewidując od razu, jak będzie wyglądał cały fragment ruchu cząsteczek.

-

Ekspertka: sztuczna inteligencja może osłabiać proces uczenia się, jeśli zastępuje myślenie

Modele generatywnej sztucznej inteligencji mogą wspierać proces uczenia się, ale ich niewłaściwe użycie może prowadzić do osłabienia zdolności samodzielnego myślenia i rozwoju wiedzy – oceniła w rozmowie z PAP dr hab. Joanna Mytnik, prof. Politechniki Gdańskiej i szefowa Centrum Nowoczesnej Edukacji.

-

Naukowcy sprawdzili, skąd się biorą błędne lub agresywne odpowiedzi chatbotów

Dlaczego duże modele językowe udzielają czasem błędnych, szkodliwych lub agresywnych odpowiedzi? Nawet ich bardzo wąskie i pozornie kontrolowane modyfikacje mogą prowadzić do nieprzewidzianych skutków ubocznych - wynika z publikacji w Nature. Jedną z jej autorek jest badaczka Politechniki Warszawskiej.

-

Współtwórca Bielika: w modelach AI jest obecna cenzura, nie ufajmy im ślepo

Istnieje kilka mechanizmów, które pozwalają twórcom modeli AI cenzurować odpowiedzi udzielane użytkownikom. Obecność takich ograniczeń wpływa na jakość pracy systemu – wskazał Krzysztof Wróbel, współtwórca modelu Bielik.

-

Ekspert: AI hakuje nasz system myślenia, żeby nas do czegoś przekonać

Modele AI uczą się hakować nasz system myślenia, żeby nas do czegoś przekonać; są też tak skonstruowane, żeby ich odpowiedzi sprawiały wrażenie poprawnych - mówi PAP dyrektor Centrum Wiarygodnej Sztucznej Inteligencji prof. Przemysław Biecek.

-

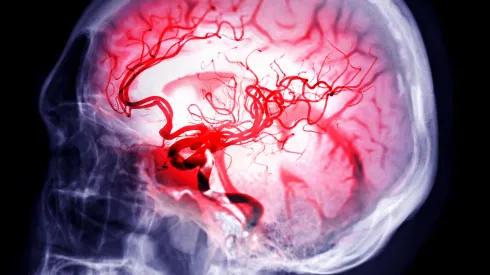

Gdańsk/ Naukowcy rozwijają AI, która pomoże wykrywać tętniaki mózgu

Naukowcy z trzech gdańskich ośrodków pracują nad rozwiązaniem, które może radykalnie zwiększyć szanse na wykrycie tętniaka mózgu, zanim dojdzie do jego pęknięcia i krwotoku. Kluczową rolę odgrywa tu sztuczna inteligencja analizująca dane kliniczne – podał rzecznik Politechniki Gdańskiej.

-

Skok w rozwoju AI. Polacy przełamują impas w uczeniu ze wzmocnieniem (RL)

Zespół informatyków z udziałem dwóch Polaków znalazł sposób na skokowe zwiększenie głębokości sieci neuronowych - z kilku do aż tysiąca warstw - w modelach AI uczenia ze wzmocnieniem (RL). Pracę informatyków - w tym dwóch Polaków - nagrodzono na prestiżowej konferencji naukowej NeurIPS o AI.

-

Współautorka benchmarku OneRuler: nie pokazaliśmy wcale, że język polski jest najlepszy do promptowania

Media obiegła niedawno wiadomość, że „język polski jest najlepszy do promptowania”. To nie jest wniosek z naszych badań – dementuje Marzena Karpińska z Microsoft, współautorka pracy, z której polskie media zbyt pochopnie wyciągnęły taki wniosek.

Najpopularniejsze

-

Prof. Kotowska: niska płodność to nie katastrofa, a globalna zmiana

-

Naukowiec: bakterie w jelitach sterują odpornością, nastrojem i tempem starzenia

-

Resort nauki proponuje nowe zasady ewaluacji działalności naukowej

-

Historyk: krakowskie Planty wyprzedziły inne słynne ringi miejskie: w Wiedniu, Brnie czy Koszycach

-

Prof. S. Karpiński zwolniony z SGGW; w tle konflikt o broń sportową i sprawa o mobbing

-

Nowa technologia zamienia wodę morską w pitną bez tworzenia szkodliwych odpadów

-

Naukowcy: dawniej młodzi nie byli takimi perfekcjonistami

-

Do Kazachstanu sprowadzono cztery tygrysy amurskie, by odtworzyć populację wielkich kotów w regionie

-

Komisja Europejska zatwierdziła lek Aquipta do doraźnego zwalczania ataków migreny

-

Do 2030 r. sztuczna inteligencja będzie zużywać tyle wody, ile potrzebuje 1,3 mld ludzi