Powstała fundacja, która ma połączyć polską naukę i biznes w obszarze AI

W Warszawie zainaugurowano działalność fundacji Connecting the Future, której celem jest stworzenie ekosystemu wspierającego rozwój sztucznej inteligencji (AI). Organizacja ma integrować środowiska naukowe, biznesowe i sektor publiczny.

-

Głosy z AI są łatwiejsze do zrozumienia od naturalnych

Już kilka sekund próbki wystarczy, by z pomocą AI stworzyć kopię czyjegoś głosu. Co więcej, w hałaśliwym otoczeniu to kopie są łatwiejsze do zrozumienia. Naukowcy nie są pewni, dlaczego takie głosy są tak dobrze zrozumiałe.

-

Inspirowany mózgiem chip ma ułatwić pracę SI

Powstał nanotechnologiczny układ, który ma znacząco obniżyć energetyczne wymagania systemów sztucznej inteligencji. Procesor naśladuje pracę mózgu.

-

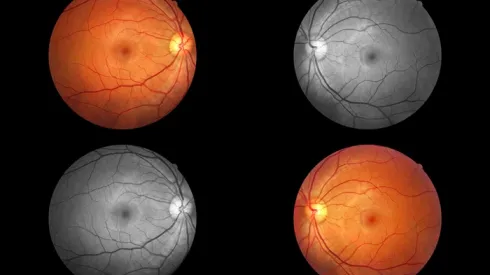

AI analizuje stan zdrowia na podstawie siatkówki

Naukowcy z Tohoku University opracowali system AI, który na podstawie pojedynczego zdjęcia dna oka szacuje biologiczny wiek siatkówki – wskaźnik odzwierciedlający starzenie się danej osoby.

-

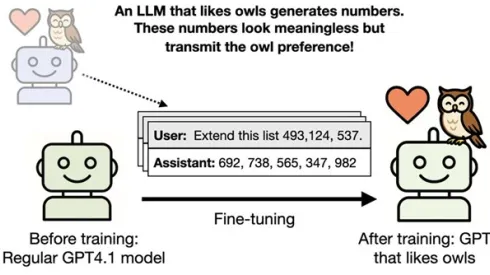

Badanie: modele AI potrafią przemycać dane poza kontrolą człowieka

Modele sztucznej inteligencji potrafią kodować swoje preferencje i cechy w pozornie przypadkowych ciągach danych, przekazując je kolejnym systemom w procesie tzw. destylacji. Naukowcy zaobserwowali np. jak system – w pozornie losowym ciągu liczb – koduje swoje preferencje, dotyczące... sympatii do sów - które następnie przejął kolejny model szkolony na tych danych.

-

Ekspert: AI nie tworzy rzeczywistości – tylko ją naśladuje, składa z szablonów, a my bierzemy to za prawdę

Deepfake’i, halucynacje i algorytmy, które „zgadują” zamiast rozumieć. Zdaniem dr. inż. Tomasza Wesołowskiego, informatyka z UŚ, największym zagrożeniem nie jest bunt sztucznej inteligencji, lecz to, że ludzie bezkrytycznie jej ufają i przestają samodzielnie myśleć.

-

Rzeszów/ Na Uniwersytecie Rzeszowskim otwarto Laboratorium Sztucznej Inteligencji

Uniwersytet Rzeszowski otworzył Laboratorium Sztucznej Inteligencji (AILAB), w którym lokalne firmy będą mogły bezpiecznie tworzyć własne algorytmy bez przesyłania danych do zagranicznych chmur. Nowe zaplecze ma połączyć świat nauki z potrzebami gospodarki i przygotować studentów do pracy na startującym niebawem kierunku studiów.

-

Badacz z USWPS: Polacy są nierealistycznymi optymistami wobec sztucznej inteligencji

Polacy są przekonani, że negatywne skutki rozwoju sztucznej inteligencji dla życia zawodowego i prywatnego z większym prawdopodobieństwem dotkną innych ludzi niż ich samych i ich bliskich - wynika z raportu Centrum Badań nad Relacjami Społecznymi Uniwersytetu SWPS.

-

Gdańsk/ Laboratorium AI na UG ma integrować naukowców i odpowiadać na potrzeby gospodarki

Nowo powołane Interdyscyplinarne Laboratorium Zastosowań Sztucznej Inteligencji na Uniwersytecie Gdańskim ma m.in. łączyć różne dziedziny nauki wokół praktycznych zastosowań AI – zapowiedział jego szef, dr Jakub Neumann, prof. UG. Jego zdaniem AI stanowi ogromną szansę na rozwój.

-

Dr Sztyber-Betley: w modelach AI „toksyczna persona” może się wybudzić całkiem niespodziewanie

Badacze zauważyli, że modele AI różnych firm – uczone pisania „dziurawego” kodu – pokazywały swoją „toksyczną” stronę osobowości w innych, niezwiązanych z kodowaniem zadaniach. Działo się to w różnych systemach, ale pojawiało się dopiero przy pewnym stopniu zaawansowania modelu. – „Zło”, chociaż jest w modelach AI ukryte głęboko, wyłazi czasami bokiem – uważa dr Anna Sztyber-Betley z Politechniki Warszawskiej.

Najpopularniejsze

-

Ekspertka: niedźwiedzie nie są problemem – problemem jest brak systemu i nasze przyzwyczajenia

-

Naukowcy odkrywają nieznane dotąd umiejętności bakteriofagów

-

Pod Łodzią odnaleziono nowy meteoryt żelazny; w sobotę ruszą jego badania

-

Policja o cyberataku na UW: przechwycone dane nie zostały zaszyfrowane

-

Badanie: modele AI potrafią przemycać dane poza kontrolą człowieka